A arquitetura aberta do Roblox permite que usuários publiquem experiências interativas com facilidade e baixo custo. Esse formato está associado ao crescimento da plataforma e à sua identificação pública como espaço criativo voltado ao público infantojuvenil. A mesma estrutura, no entanto, permite a circulação de jogos conhecidos como “condos”, experiências criadas por usuários com temática sexualizada e frequentemente estruturadas para contornar filtros automatizados.

Leia também:

- Review | No.1 Sentai Gozyuger: Muitas promessas, para poucas entregas

- Wall-E: um filme de 2008 que parece ter sido feito para 2026

- O jogo “Öoo” que você provavelmente nunca ouviu falar

O conteúdo abordado neste artigo envolve aspectos sensíveis do ambiente digital e deve ser lido sob a perspectiva de prevenção. Em uma plataforma com presença significativa de crianças e adolescentes, a discussão interessa diretamente a responsáveis, educadores e usuários que buscam compreender riscos potenciais associados a falhas de moderação e exposição indevida.

Esses servidores costumam permanecer ativos por períodos curtos antes de serem removidos. Em observação realizada em área pública da plataforma, experiências com características sugestivas ficaram acessíveis por mais de dez minutos. As conversas internas não estavam visíveis na área analisada, e não há ferramenta pública que permita verificar a idade dos participantes.

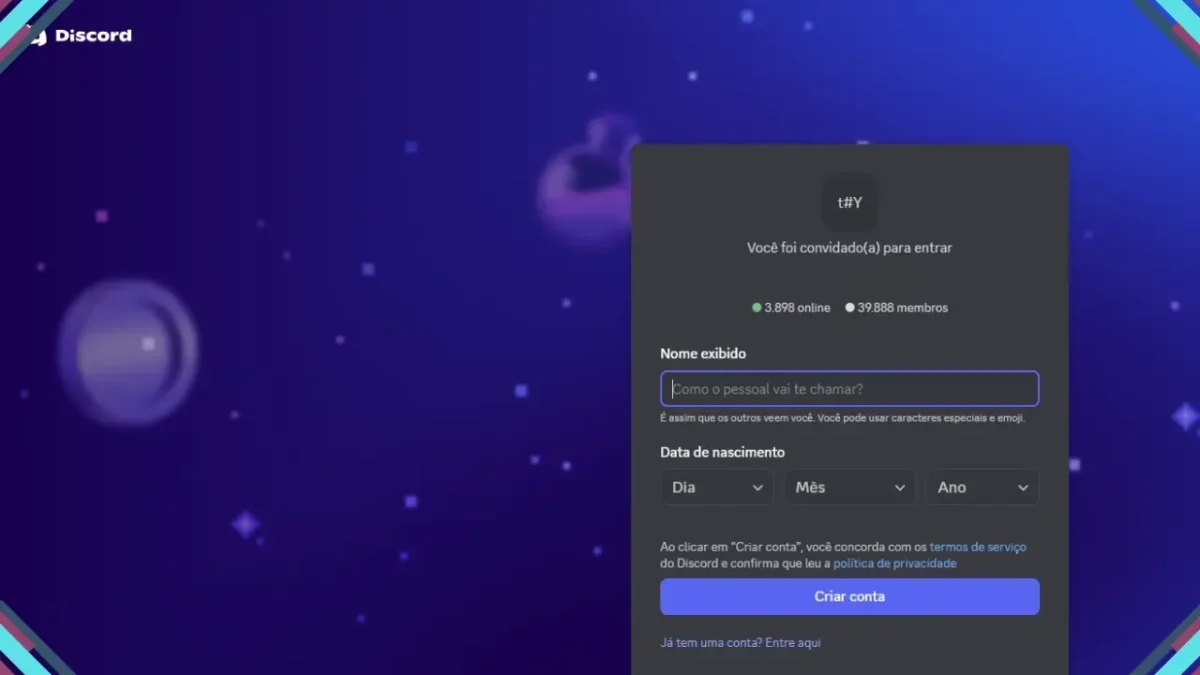

Menções a esse tipo de conteúdo aparecem em jogos de roleplay e em comunidades externas, onde usuários citam a existência desses ambientes e, em alguns casos, compartilham formas de acesso. Parte das experiências exige link direto ou senha divulgada fora da plataforma, inclusive em servidores no Discord. A circulação ocorre tanto por mecanismos internos quanto por canais paralelos de distribuição.

Moderação ativa, mas necessita de maior solidez

A repetição do ciclo de criação e remoção indica limitações operacionais no controle preventivo, questão sensível em uma plataforma com ampla presença de menores. Quando um servidor é derrubado, outro pode surgir com nome modificado ou descrição ambígua, dificultando a identificação automática.

Nenhum link ativo, nome de servidor ou rota de acesso será divulgado neste texto. A proposta é discutir o funcionamento do sistema e seus pontos de vulnerabilidade, não ampliar a visibilidade dessas experiências.

Outro ponto sensível envolve os mecanismos de busca internos. Experiências sem classificação clara podem aparecer em resultados genéricos, o que amplia o risco de acesso não intencional. Um usuário que procura jogos populares ou explora recomendações pode se deparar com conteúdos inadequados sem ter buscado esse tipo de material.

A questão central não é afirmar a ocorrência de crime específico, mas analisar vulnerabilidades conhecidas. Plataformas com grande base de menores dependem de sistemas de detecção automatizada combinados a denúncias da comunidade. Em ambientes de criação aberta e volume massivo de uploads, o tempo de resposta torna-se fator crítico.

Modelos alternativos de distribuição digital oferecem contraste. No Steam, por exemplo, a publicação de jogos envolve taxas e processos de revisão que funcionam como barreira inicial contra uploads automatizados ou scripts maliciosos. A adoção de uma taxa simbólica ou de etapas adicionais de verificação poderia reduzir a reincidência de experiências criadas apenas para contornar filtros, ainda que não elimine completamente o problema.

Desde episódios de mobilização dentro da comunidade, como a controvérsia envolvendo o jogo Brookhaven e a exigência de verificação facial para estimativa de idade em determinados recursos, a plataforma passou a implementar restrições adicionais. Entre elas, a limitação de chat por voz e texto conforme a faixa etária estimada do usuário.

O tema ganhou relevância pessoal a partir de questionamentos recorrentes de crianças próximas sobre a possibilidade de utilizar o Roblox. A partir disso, a observação passou a ser mais sistemática. Em artigo anterior, que relato trinta dias de imersão na plataforma, foram descritos os desafios de acompanhar o volume de interações e narrativas geradas diariamente.

Durante esse período, surgiram menções recorrentes a ambientes conhecidos como “condos”, citados abertamente por usuários em diferentes contextos. A existência dessas experiências não é recente, e a empresa responsável, Roblox Corporation, mantém políticas formais contra conteúdo sexualizado.

Ainda assim, a recorrência de servidores com características sugestivas indica que o problema não se restringe a episódios isolados. Um intervalo superior a dez minutos de disponibilidade pode parecer curto, mas, em um ambiente com alta presença de menores, qualquer janela de exposição inadequada é relevante.

Processos relacionados a alegações de falhas de moderação

Em janeiro deste ano, em Chicago, nos Estados Unidos, foi protocolada uma ação judicial contra a Roblox Corporation na qual o pai de um menor alega que o filho teria sido exposto a conduta inadequada por meio da plataforma. A empresa contesta as alegações, e o caso segue em tramitação.

Separadamente, no Distrito Norte da Califórnia, onde tramitam processos envolvendo empresas de tecnologia sediadas na região, há ações que discutem a forma como os Robux são utilizados dentro da plataforma. Esses procedimentos tratam de aspectos comerciais e de governança digital e também permanecem sob análise judicial.

Não foram identificadas, durante a observação relatada neste texto, abordagens explícitas ou indivíduos confirmadamente envolvidos em conduta criminosa. Usuários veteranos ouvidos relataram, contudo, já terem recebido interações consideradas inadequadas em chats abertos e privados, o que reforça a percepção de vulnerabilidade em ambientes amplamente acessíveis.

Outro ponto citado por usuários envolve a utilização de Robux como elemento de troca em interações irregulares. Não houve verificação independente dessas alegações nesta apuração, mas o tema aparece com frequência em debates da comunidade.

A circulação de links em servidores no Discord permanece como um dos vetores de divulgação desses jogos. Comunidades externas funcionam como canais paralelos de distribuição, o que dificulta o controle exclusivamente interno.

Especialistas em governança digital defendem que barreiras adicionais na publicação de experiências — como etapas de verificação mais extensas ou custos simbólicos — poderiam reduzir a criação automatizada de ambientes destinados a burlar filtros. Plataformas como o Steam adotam mecanismos de taxa e revisão prévia para publicação, modelo que limita uploads massivos, citado anteriormente.

Polêmicas em outras plataformas

Compreendo que a Valve — assim como a GOG, que no passado operava sob a CD Projekt Red e posteriormente foi adquirida por um de seus fundadores — permita a comercialização de títulos com classificação indicativa mais elevada. Entretanto, essas plataformas adotam políticas rigorosas de verificação etária, com filtros avançados que impedem o acesso imediato a conteúdos sensíveis.

Em 2025, uma polêmica envolvendo a Collective Shout, organização australiana de ativismo, pressionou empresas de pagamento a boicotarem a Steam, a GOG e outras lojas digitais que disponibilizassem jogos com conotações adultas. A iniciativa, porém, produziu efeito contrário; parte da comunidade de jogadores reagiu negativamente, argumentando que a campanha não enfrentava o cerne da questão regulatória, mas optava por uma generalização que colocava diferentes tipos de conteúdo sob o mesmo rótulo.

A discussão não envolve a supressão de jogos de RPG, ação ou aventura, que compõem a maior parte do ecossistema. O ponto central é a necessidade de reduzir brechas exploradas por experiências que contrariam as próprias diretrizes da plataforma.

O avanço de ferramentas automatizadas e inteligência artificial no Roblox adiciona uma colaboração adicional ao desafio, transformando a moderação em uma disputa contínua entre detecção e evasão.

Pois, o desafio reside em equilibrar liberdade criativa e proteção do público vulnerável. Enquanto servidores com temática inadequada continuam a surgir e permanecer ativos por intervalos perceptíveis, permanece o debate sobre até que ponto o modelo atual de moderação consegue acompanhar a escala da própria plataforma.

O intuito desta publicação é alertar responsáveis de que a responsabilidade pela segurança digital não recai exclusivamente sobre a plataforma. Embora existam mecanismos internos de controle e moderação, não é prudente terceirizar integralmente esse cuidado. O acompanhamento ativo das atividades online e das interações realizadas por crianças e adolescentes continua sendo uma medida essencial de prevenção.

A Roblox Corporation tem implementado novos recursos e ajustes em seus sistemas de monitoramento para coibir condutas que violem suas políticas de uso na plataforma Roblox, em um processo contínuo de atualização e aprimoramento.